Bienvenido a nuestra sección de Marketing, el espacio donde desglosamos las estrategias que mueven los mercados actuales. Aquí encontrarás desde guías paso a paso y análisis de tendencias digitales, hasta consejos prácticos para optimizar tu branding y aumentar tus ventas.

Ya seas un emprendedor buscando sus primeros clientes o un director de marketing persiguiendo mejores métricas, nuestros artículos están diseñados para darte las herramientas y la inspiración que necesitas para llevar tu negocio al siguiente nivel. ¡Explora nuestros últimos artículos y mantente a la vanguardia!

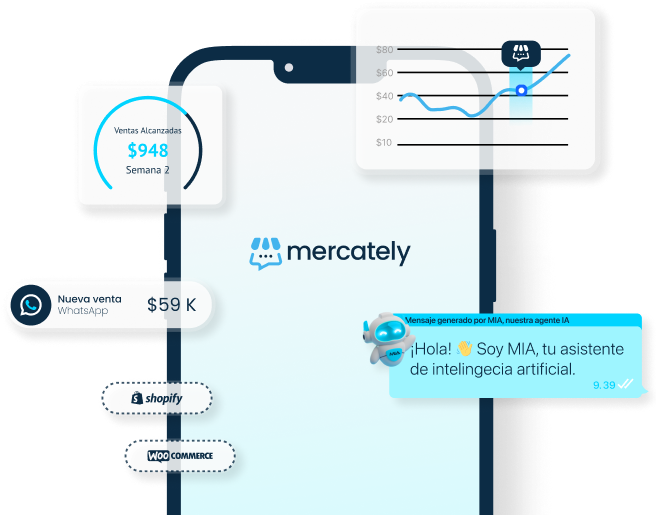

Activa nuestra IA y descubre un nuevo nivel de automatización en tus ventas.

Miles de negocios ya venden más con Mercately, ¿listo para ser el próximo?